- Objective:

- Breadcrumb:

# 概念阐释

张量(tensor)是数学和物理中的一个概念,广泛应用于线性代数、微分几何、物理学和深度学习等领域。能够表示标量、[[vector 向量]]、矩阵以及更高维度的对象。

**简单来说,张量的概念可以分为以下几个层次:**

1. **标量(0阶张量)**:**只有一个数值**,通常是一个实数或复数。例如,数字5是一个标量。

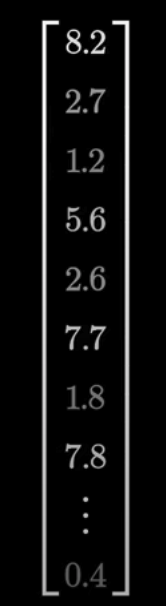

2. **向量(1阶张量)**:是**一维数组**,包含多个数值。例如,一个3维向量可以表示为 $[1, 2, 3]$

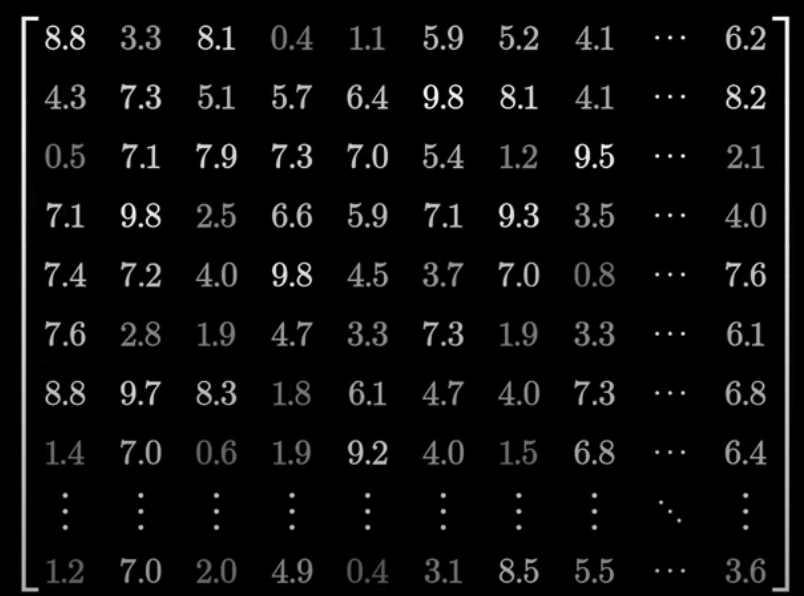

3. **矩阵(2阶张量)**:是**二维数组**,包含行和列。例如,一个2×2矩阵可以表示为 $ \begin{bmatrix} 1 & 2 \\ 3 & 4 \end{bmatrix}$

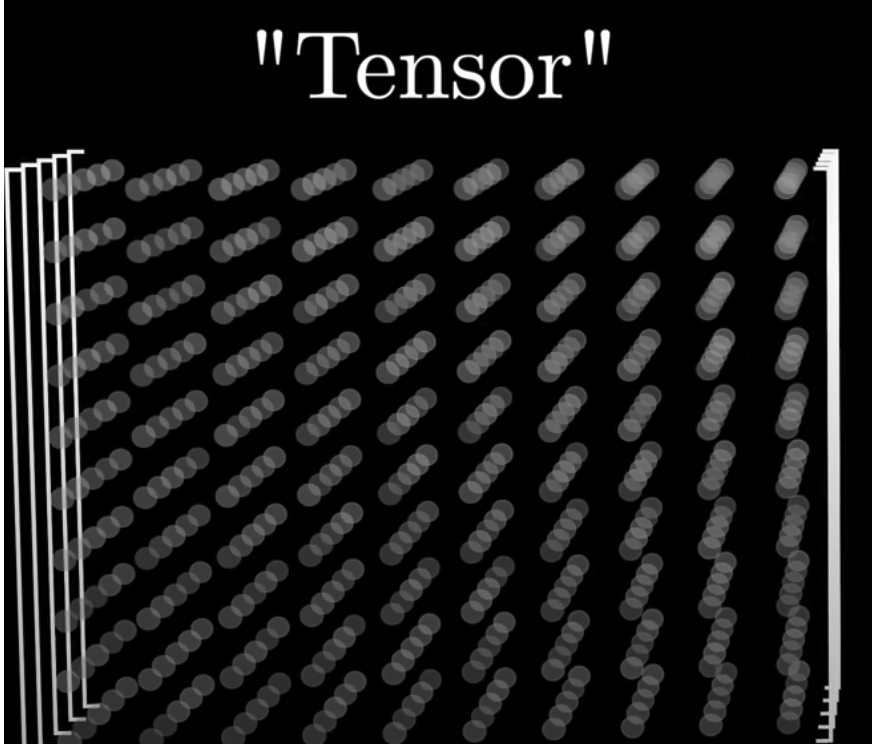

4. **更高阶张量**:当张量的维度超过2时,我们称之为高阶张量。例如,一个3阶张量可以看作是一个三维数组,类似于一个立方体结构,用来存储复杂的数据。

张量的维度被称为**阶**,而每一阶代表该张量的维度数。例如:

- 0阶张量是标量,没有维度。

- 1阶张量是向量,只有一维。

- 2阶张量是矩阵,有二维(行和列)。

- 3阶及更高阶张量则表示更复杂的多维数据。

在深度学习中,张量是非常重要的,因为它们可以用来表示输入数据、神经网络的权重、激活函数的输出等。深度学习框架(如TensorFlow和PyTorch)使用张量作为基础数据结构,来处理高维数据和执行数学运算。

# 实例

- 深度学习中的向量

- 深度学习中的矩阵

- 深度学习中的张量

# 相关内容

# 参考资料