基于视频数据的生成模型的大规模训练、text-conditional diffusion models / transformer architecture

1)所有类型的视觉数据转化为统一表示的方法,从而能够大规模训练生成模型,以及(2)对Sora的能力和局限性进行定性评估。

之前的许多工作已经研究了使用各种方法对视频数据进行生成建模,包括循环网络recurrent networks、生成对抗网络generative adversarial networks、自回归转换器autoregressive transformers和扩散模型diffusion models。这些作品通常专注于一类狭窄的视觉数据、较短的视频或固定大小的视频。Sora 是一种多面手的视觉数据模型,它可以生成跨越不同**持续时间**、**纵横比**和**分辨率**的视频和图像,最高可达一整分钟的高清视频。

## 1. 将视觉数据转换为视觉块代码patches:

灵感来源于大型语言模型 LLM 的 token,**视觉块代码**是一种**高度可扩展**且有效的表示形式,用于在不同类型的视频和图像上训练生成模型。

在高层次上,我们首先将视频压缩到低维潜在空间中,然后将表示分解为**时空视觉块代码(包含时间和空间的信息小方块)**,再在生成新视频时重组这些信息小方块

## 2. Video compression network视频压缩网络

- 我们训练一个降低视觉数据维度的网络

- 输入:原始视频,输出:时间和空间上都经过高度压缩的潜在表示

- sora 在这个压缩空间内接受训练并随后生产视频

- 同时我们训练一个**解码器 decoder**模型,将生成的视频还原为像素级视频图像

## 3. Spacetime Latent Patches时空潜伏视觉块代码

- 给定一段高度压缩的视频,我们提取一系列**时空视觉块代码** spacetime patches,就像 transformer tokens

- 这个方案 scheme 也适用于图像,因为图像不过是一帧的视频

- 基于视觉块代码 patches 能够使sora 对可变分辨率 resolutions、持续时间durations和宽高比aspect ratios的视频和图像进行训练,在生成新视频内容时,可以通过将这些随机初始化的 patchs 按照需要的大小排列成网格,来控制最终视频的大小和形式。

- 在推理时,我们可以通过在适当大小的网格中排列随机初始化的视觉块代码来控制生成视频的大小。

## 用于视频生成的缩放变压器 Scaling transformers for video generation

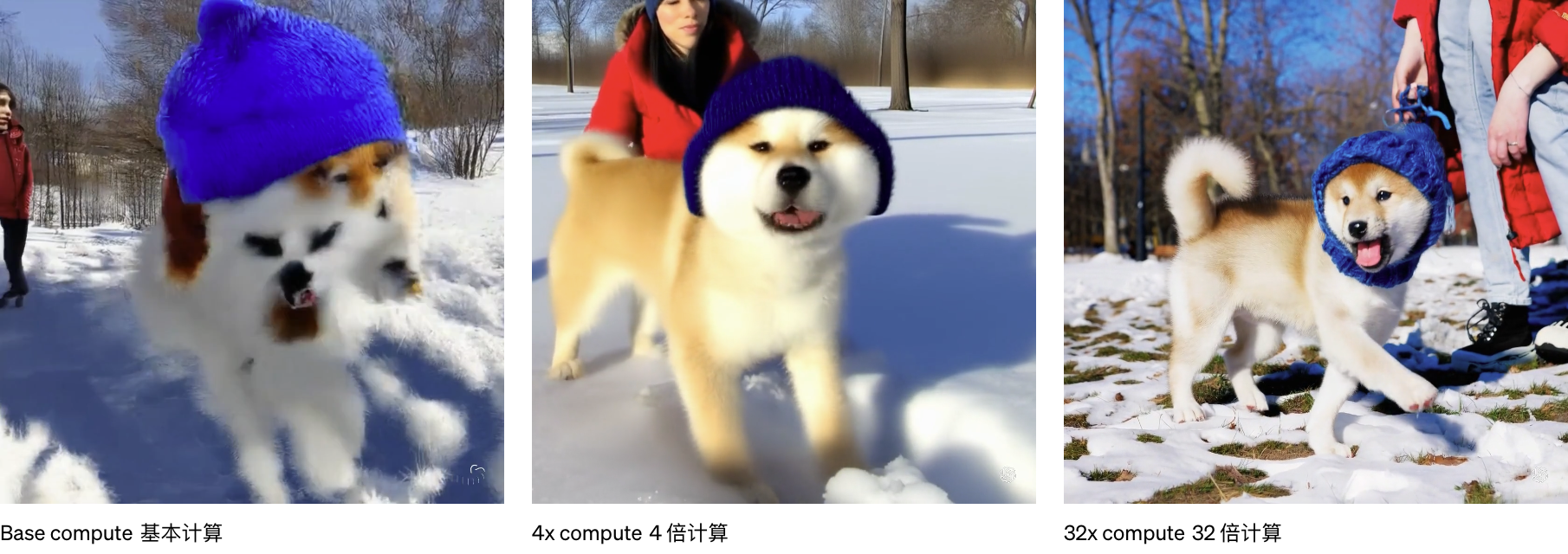

- sora 是一种可扩展模型 diffusion model,更是一种 **diffusion transformer 模型**。diffusion transformer 在扩展视频模型上的效果很好。随着训练计算量的增加,样本质量得到了显著提高。

## Variable durations, resolutions, aspect ratios可变持续时间、分辨率、纵横比

过去的图像和视频生成方法通常会将视频调整大小、裁剪或修剪为标准大小,例如,分辨率为 256x256 的 4 秒视频。我们发现,相反,以原生大小对数据进行训练有几个好处:

- Sora 训练时没有对素材进行裁切,使得 Sora 能够直接按照不同设备的原生宽高比native aspect ratios创建内容。

- 在视频的原生宽高比上进行训练,能够显著改善视频的[[取景]]和[[构图]]。例如将所有训练视频都裁剪成正方形后对模型进行训练,其他模型可能只能生成主体的局部,但 sora 可以取到全景。

## Language understanding语言理解

训练文本到视频生成系统需要大量带有相应文本字幕的视频。

- OpenAI 将在 DALL·E 3 中引入的**重新标注技术re-captioning technique**应用到视频上。我们首先训练一个高度描述性的字幕生成器模型,然后使用它为训练集中的所有视频生成文本字幕。我们发现,对高度描述性视频字幕进行训练可以提高文本保真度以及视频的整体质量。

- 与 DALL·E 3 类似,我们还利用 **GPT** 将简短的用户提示转换为较长的详细字幕,然后发送到视频模型。这使得 Sora 能够生成准确遵循用户提示的高质量视频。

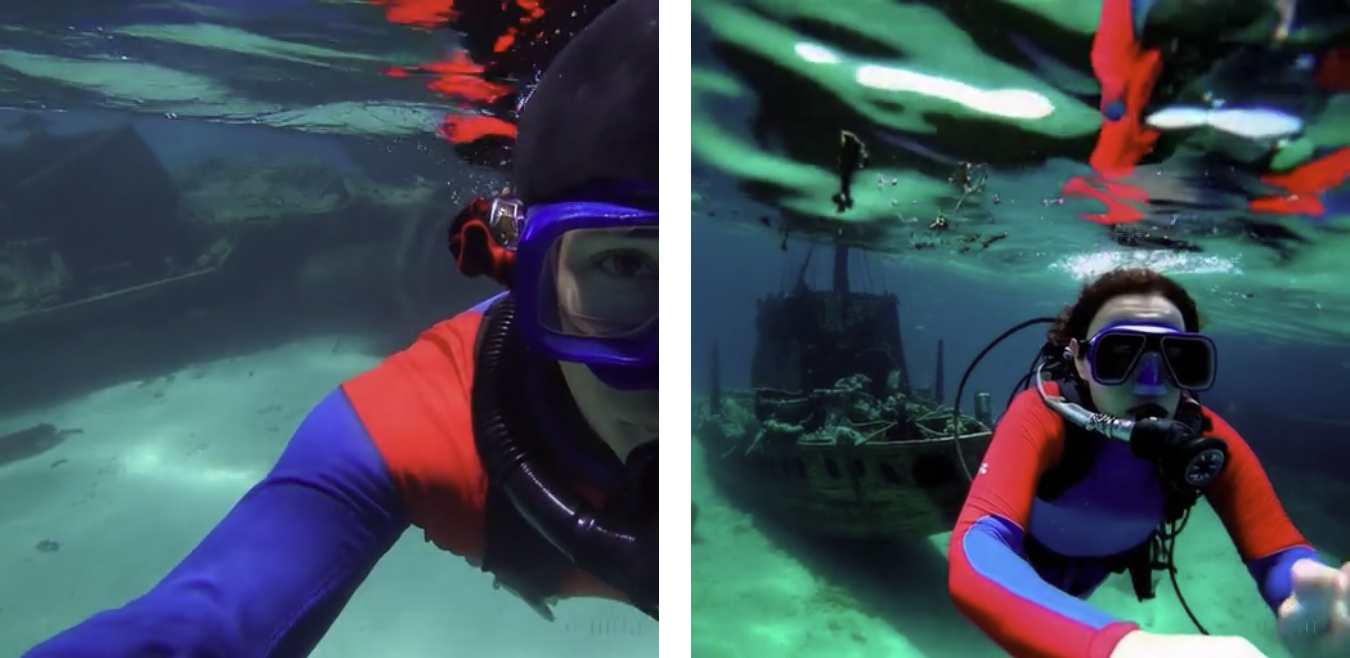

## Animating DALL·E imagesDALL·E 图像动画

基于 DALL·E 2 和 DALL·E 3 图像生成的示例视频。

## Sora示例

## Sora的局限

Ref.

- [ ] 技术论文:[Video generation models as world simulators](https://readwise.io/reader/shared/01hprwhqtdcpkygj6xyj9j57t2)